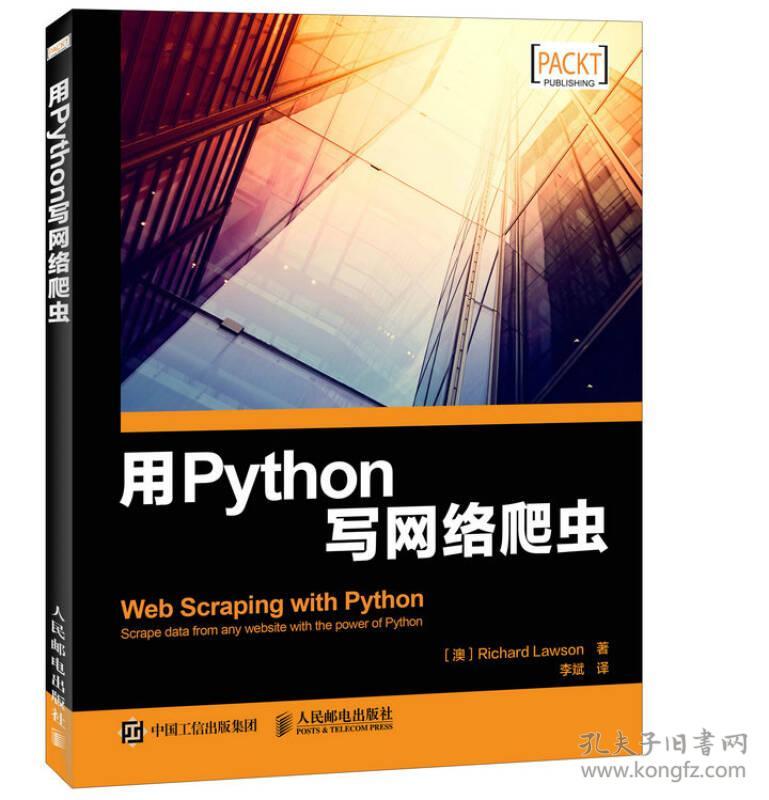

用Python写网络爬虫

¥ 13.53 3.0折 ¥ 45 九品

仅1件

北京东城

认证卖家担保交易快速发货售后保障

作者[澳]理查德·劳森(Richard Lawson) 著;李斌 译

出版社人民邮电出版社

出版时间2016-08

版次1

装帧平装

货号A1

上书时间2024-12-18

- 最新上架

商品详情

- 品相描述:九品

图书标准信息

- 作者 [澳]理查德·劳森(Richard Lawson) 著;李斌 译

- 出版社 人民邮电出版社

- 出版时间 2016-08

- 版次 1

- ISBN 9787115431790

- 定价 45.00元

- 装帧 平装

- 开本 16开

- 纸张 胶版纸

- 页数 157页

- 正文语种 简体中文

- 原版书名 web scraping with python

- 【内容简介】

-

《用Python写网络爬虫》讲解了如何使用Python来编写网络爬虫程序,内容包括网络爬虫简介,从页面中抓取数据的三种方法,提取缓存中的数据,使用多个线程和进程来进行并发抓取,如何抓取动态页面中的内容,与表单进行交互,处理页面中的验证码问题,以及使用Scarpy和Portia来进行数据抓取,使用本书介绍的数据抓取技术对几个真实的网站进行了抓取,旨在帮助读者活学活用书中介绍的技术。

《用Python写网络爬虫》适合有一定Python编程经验,而且对爬虫技术感兴趣的读者阅读。 - 【作者简介】

- RichardLawson来自澳大利亚,毕业于墨尔本大学计算机科学专业。毕业后,他创办了一家专注于网络爬虫的公司,为超过50个国家的业务提供远程工作。他精通于世界语,可以使用汉语和韩语对话,并且积极投身于开源软件。他目前在牛津大学攻读研究生学位,并利用业余时间研发自主无人机。

- 【目录】

-

第1章网络爬虫简介1

1.1 网络爬虫何时有用 1

1.2 网络爬虫是否合法 2

1.3 背景调研 3

1.3.1 检查robots.txt 3

1.3.2 检查网站地图 4

1.3.3 估算网站大小 5

1.3.4 识别网站所用技术 7

1.3.5 寻找网站所有者 7

1.4 编写第一个网络爬虫 8

1.4.1 下载网页 9

1.4.2 网站地图爬虫 12

1.4.3 ID遍历爬虫 13

1.4.4 链接爬虫 15

1.5 本章小结 22

第2章 数据抓取 23

2.1 分析网页 23

2.2 三种网页抓取方法 26

2.2.1 正则表达式 26

2.2.2 BeautifulSoup 28

2.2.3 Lxml 30

2.2.4 性能对比 32

2.2.5 结论 35

2.2.6 为链接爬虫添加抓取回调 35

2.3 本章小结 38

第3章 下载缓存 39

3.1 为链接爬虫添加缓存支持 39

3.2 磁盘缓存 42

3.2.1 实现 44

3.2.2 缓存测试 46

3.2.3 节省磁盘空间 46

3.2.4 清理过期数据 47

3.2.5 缺点 48

3.3 数据库缓存 49

3.3.1 NoSQL是什么 50

3.3.2 安装MongoDB 50

3.3.3 MongoDB概述 50

3.3.4 MongoDB缓存实现 52

3.3.5 压缩 54

3.3.6 缓存测试 54

3.4 本章小结 55

第4章 并发下载 57

4.1 100万个网页 57

4.2 串行爬虫 60

4.3 多线程爬虫 60

4.3.1 线程和进程如何工作 61

4.3.2 实现 61

4.3.3 多进程爬虫 63

4.4 性能 67

4.5 本章小结 68

第5章 动态内容 69

5.1 动态网页示例 69

5.2 对动态网页进行逆向工程 72

5.3 渲染动态网页 77

5.3.1 PyQt还是PySide 78

5.3.2 执行JavaScript 78

5.3.3 使用WebKit与网站交互 80

5.3.4 Selenium 85

5.4 本章小结 88

第6章 表单交互 89

6.1 登录表单 90

6.2 支持内容更新的登录脚本扩展 97

6.3 使用Mechanize模块实现自动化表单处理 100

6.4 本章小结 102

第7章 验证码处理 103

7.1 注册账号 103

7.2 光学字符识别 106

7.3 处理复杂验证码 111

7.3.1 使用验证码处理服务 112

7.3.2 9kw入门 112

7.3.3 与注册功能集成 119

7.4 本章小结 120

第8章 Scrapy 121

8.1 安装 121

8.2 启动项目 122

8.2.1 定义模型 123

8.2.2 创建爬虫 124

8.2.3 使用shell命令抓取 128

8.2.4 检查结果 129

8.2.5 中断与恢复爬虫 132

8.3 使用Portia编写可视化爬虫 133

8.3.1 安装 133

8.3.2 标注 136

8.3.3 优化爬虫 138

8.3.4 检查结果 140

8.4 使用Scrapely实现自动化抓取 141

8.5 本章小结 142

第9章 总结 143

9.1 Google搜索引擎 143

9.2 Facebook 148

9.2.1 网站 148

9.2.2 API 150

9.3 Gap 151

9.4 宝马 153

9.5 本章小结 157

点击展开

点击收起

相关推荐

— 没有更多了 —

以下为对购买帮助不大的评价